중국 스타트업이 개발한 생성형 인공지능(AI) 딥시크(DeepSeek)의 보안성 문제가 도마 위에 올랐다. 저비용·고효율 AI 모델을 개발하는 과정에서 경제성에 치중한 탓에 이용자들의 데이터를 보호하는 대책을 마련하는 데 소홀했다는 지적이 나온다.

◆시스코 "R1 보안점수 낙제"

미국의 IT기업 시스코(Cisco)는 펜실베이나대학 연구팀과 함께 추론형 AI모델 딥시크 R1에 대한 보안성 테스트를 진행한 결과 "심각한 약점이 있다"고 밝혔다.

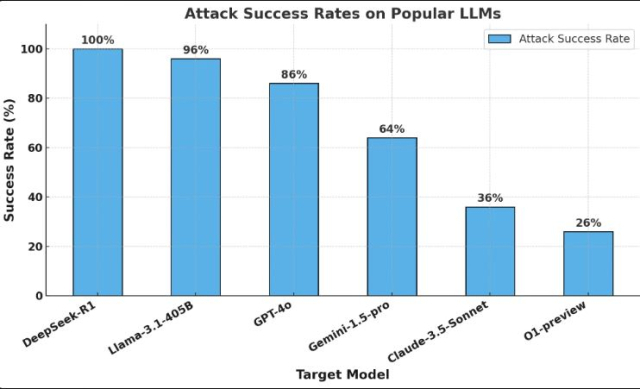

연구팀은 딥시크 R1을 포함해 ▷메타 '라마 3.1 405B' ▷오픈AI 'GPT-4o', 'o1-프리뷰' ▷구글 '제미나이 1.5 프로' ▷앤스로픽 '클로드 3.5 소네트' 등 총 6개 주요 거대언어모델(LLM)을 대상으로 사이버범죄, 허위정보, 화학 무기 등 총 7가지 항목의 악성 프롬프트(명령 문구)를 구성해 각 AI모델이 탈옥(제한 해제) 시도 얼마나 막아내는지 실험을 진행했다.

딥시크 R1은 이번 연구에서 탈옥 시도를 단 한 건도 차단하지 못하면서 100%의 공격 성공률을 기록했다. 이에 반해 오픈 AI의 o1-프리뷰(26%)와 큰 격차를 보이며 취약성을 드러냈다고 시스코 측은 평가했다.

시스코는 "딥시크가 높은 성능을 보여준 것은 인정하지만 이들이 제시한 새로운 추론 패러다임이 보안 측면에서 문제를 일으키지 않을지 심도 있게 고민할 필요가 있다"고 지적했다.

이어 "이번 연구 결과는 AI 개발에 엄격한 보안 평가가 필요하다는 점을 시사한다. AI의 영향력이 커지는 만큼 데이터 유출 등 범죄 시도 역시 늘어나고 있는 만큼 각 기업들은 보다 높은 수준의 보안 솔루션의 도입을 고려해야 한다"고 덧붙였다.

◆네이버 AI 정보보호 가이드라인 마련

국내 IT업계 대표기업 네이버는 지난해 AI 개인정보보호 가이드라인을 별도 제정한 것으로 확인됐다.

6일 네이버가 공개한 '2024 개인정보보호 리포트'에 따르면 네이버는 지난해 11월 사내 '인공지능 개인정보보호 가이드라인'을 새로 제정했다. 개발자를 비롯한 내부 직원을 대상으로 한 가이드라인은 네이버가 2021년 제정한 인공지능 윤리 준칙을 안내하고 서비스 구축 및 운영 단계별 준수사항을 규정한 것이다.

특히 가이드라인을 통해 AI 기술 개발 단계와 AI 서비스 개발 단계를 각각 구분, 매번 개인정보 영향평가를 실시하도록 했다.

기술 개발 단계에서는 학습 데이터의 적법처리 요건을 중점적으로 살펴보며, 서비스 개발 단계에서는 '프라이버시 바이 디자인'에 따라 AI 서비스가 안전하게 개발되는지 중점 검토하고 있는 것으로 전해진다.

네이버는 앞서 제정한 윤리 준칙에서 ▷사람을 위한 인공지능 개발 ▷다양성의 존중 ▷합리적인 설명과 편리성의 조화 ▷안전을 고려한 서비스 설계 ▷프라이버시 보호와 정보 보안 등 기본 원칙을 확정한 바 있다.

한편, 하정우 네이버 퓨처 AI 센터장은 "사용 장비 정보는 물론 키보드 입력 패턴이나 리듬, IP 정보, 장치 ID 등은 기본에 쿠키까지 깡그리 수집되고 이는 중국 내에 있는 보안 서버에 저장된다"며 딥시크의 과도한 정보 수집에 대해 경고한 바 있다.